想象一下,你驾驶一辆车,正打算从一个十字路口左转:

这条路没有交通信号灯或停车标志——你不仅需要在快速的车流中找到行驶空档,还要确保一旦这样做,右车道的车辆会与你相撞。

这种「无保护左转」(即没有交通信号灯或停车标识引导的左转)有多个形式,稍微不那么复杂的版本是:

当你在红绿灯处时,圆形绿灯(不是绿色箭头)示意让你前进,如果你想向左转,就必须在迎面而来的车流中找到一个空隙。

你可能没有注意到,一个看似简单的「左转」可能会引起一系列的问题。

比如,司机要转入的车道可能已经排起了长龙。

这时,到底该开始转弯还是等车队动起来后再转?或者是确定有空间能转入之后就立刻转弯?对向车道有车辆过来吗?距离自己有多远?车辆移动速度多快?能否及时完成转弯?行人走到要转入的车道中间吗?

人类每天要应对如此复杂思考过程上百万次,但是很多时候,还是会出错。

2010 年美国交通部的一项研究通过对超过 200 万起事故调查后发现,左转判断失误导致了其中 22.2% 的事故,而右转只占其中的 1.2%——左转发生的事故几乎是右转的二十倍。

美国快递巨头 UPS 甚至取消左转,规定司机到达任何目的地的正确方法是避免左转弯; 路线规划地图软件 Waze 甚至推出一项特殊的功能,允许用户在没有左转的情况下规划路线。

「左转基本上是人类在复杂的驾驶世界中做的最复杂的事情了。」《开车经济学:我们为什么这样开车?》的作者 Tom Vanderbilt 这样说道。

1、为什么说自动驾驶左转很难?

右转有多容易呢?

——只需要引导汽车进入右转车道,在许多十字路口,司机甚至可以在红灯的情况下右转,因此这对自动驾驶汽车来说十分简单。

左转就不同了。

——路口复杂的车流、蠢蠢欲动的行人、各种各样的标线与交通标志,对自动驾驶车辆的环境感知与预测都提出了极高的挑战。

对于这种情况,人类司机一般是这样处理的:

他们会等待并观察交通路况。如果左转的机会很少,他们会调整自己的驾驶策略:

1)可能会加速得更快,比如强行左转,在车流中找到空档;

2)有时会小心翼翼进入左边有车辆行驶的车道,以示他们打算转弯,并期望其他车辆腾出空间,尤其是在车流密集、移动缓慢的情况下,他们必须「见缝插针」;

3)或者试图在各车道之间找到一个中间位置,再从中间位置向左转,移动到目标车道。

对人和自动驾驶汽车而言,左转需要观察多方面的信息来判断合适的转向时机,尤其在无保护情况下的左转。

目前,即使是最熟练的自动驾驶汽车可能也很难做到流畅地左转。工程师们发现让无人车安全左转是他们遇到最大难题之一。

在 Waymo 凤凰城总部附近的一个丁字路口,Waymo 的自动驾驶汽车在这个没有信号灯的路口左转时,常遇到麻烦——找不到机会并线切入正常行驶中的车流中。

这条路的限速约 70 公里/小时。人类司机很快完成的左转。Waymo 的自动驾驶汽车无法在无保护的情况下左转,车辆在交叉路口等待很长一段时间才能最终左转,严重影响在其身后的人类驾驶员的耐心。

其他公司,如 Zoox、Nuro.ai、Pony.ai 的报告都高频描述了无人车在路口左转时出错的问题。

显然,能否顺利完成左转,也成为了衡量自动驾驶公司技术水平的一个重要指标。

麻省理工学院自动驾驶研究方向的教授这样形容左转:「每天都有很多挑战,左转几乎在问题列表的最上方。」

Waymo 行为团队负责人、软件工程师 Nathaniel Fairfield 表示:无保护的左转是自动驾驶中最棘手的事情之一。

Fairfield 带领的这个团队主要专注如何让自动驾驶汽车按照计划的路线驾驶,解决包括「让汽车固定在各自的车道」,「在驾驶中做出决策并预测其他车辆的行为」等多层问题。

因此,要解决这个问题,很重要的一点是,自动驾驶汽车必须与人类驾驶的汽车有交互,并做出实时计算。

如果自动驾驶汽车开始转弯时,需要计算其他人是否会减速,这就像人类在做同样的操作时需要在心里做出预估一样。

或者,自动驾驶车辆需要弄清楚如何「礼貌要求」其他车辆让路。当然,有时路上的其他人并不都会配合这个请求。

这就是为什么工程师们说左转很难——因为了解人的心思很难。

据汽车之心(微信 ID:Auto-bit)了解,人类驾驶员可以通过手势或眼睛跟其他驾驶员进行非语言交流,通过彼此间细微的信号(比如手势、眼神、鸣笛、转向灯等)来判断在复杂多变的交通状况下,什么时候才能安全左转。然而自动驾驶汽车却做不到这一点。

原因在于,自动驾驶汽车并不使用大脑灰质和肌肉记忆,而是通过编程、AI 和车载感知系统(如激光、摄像头和雷达)换道。

所以,教会一台机器在复杂的交通状况中左转困难无比。

对自动驾驶汽车来说,判断来车的距离和速度反而变成了简单的部分。通过 GPS 导航装置、摄像头、激光雷达和毫米波雷达等,自动驾驶汽车可以准确地测量任何在其路径上的物体的位置和速度。

但自动驾驶不能判断这些汽车和行人下一步将会做什么。

因此,自动驾驶汽车需要读懂人类的心理——来自其他司机和行人的微妙的信号——来完成路上最最困难的操作。这其中不仅涉及技术,还涉及心理学。

2、人与车的博弈:人类意图才是根本挑战

对自动驾驶汽车来说,人类意图(Human intent)才是最根本的挑战。

2017 年 5 月,Auroa CEO Chris Urmson 在卡耐基梅隆大学做了题为《Perspectives on Self-Driving Cars》的演讲。

他提到,自动驾驶汽车做出的抉择完全依赖于对人类驾驶员期望的理解和匹配。想做好这一点,不但要猜到本车驾驶员的意图,还要揣摩其他驾驶员的动向。

为了阐明「人为因素」这一关键挑战,Urmson 剖析了三次备受关注的自动驾驶事故。

谷歌自动驾驶汽车与大巴相撞

在仅有的 25 次自动驾驶事故中,有一次事故需要谷歌自动驾驶汽车承担一定的责任。

在这起事故中,谷歌无人车准备采用出道转弯的方式来转弯,但是前方遇到了一堆沙袋。当交通灯变成绿灯后,它先等几辆车驶过,然后看到一辆公交车。

对于公交车司机来说,道路上有足够的空间让他开过去。

但是对谷歌无人驾驶汽车来说,系统预测公交车会减速让无人车并线进来,但是这辆公交车并没有,结果两辆车就撞到了一起。

Uber 自动驾驶汽车遭遇翻车事故

在遭遇严重车祸前,Uber 的自动驾驶汽车正停在最左侧车道,其右侧的两车道由于车辆较多陷入了拥堵。Uber 测试车看自己车道顺畅,直接选择了继续行驶。

不过这时,却有一位司机驾车向左并线想直接左转,在并线时其他车辆遮挡了司机视线。司机可能认为其他车辆会减速慢行,于是直接并入了最左侧的车道,随后两车相撞,Uber 的测试车直接被撞翻倒地。

被撞惨的特斯拉 Model S

即使特斯拉多次强调使用 Autopilot 时要将双手放在方向盘上,但这位遭遇车祸的司机却对该功能深信不疑。

当时,车辆认为司机会时刻注意路况,成为最后一道安全防线,但司机却觉得 Autopilot 能处理这一场面。不过,他们都错了,当那辆大卡车出现在汽车面前时,车主和汽车都没发现它的存在,因此致命事故不可避免的发生了。

此次事故后,特斯拉做出了不少调整,为的就是让车辆更了解司机驾驶时的状态。这起事故表明,想用人类注意力来补足车辆的短板局限性很大。

上述案例或多或少反映了这样一个事实:为什么自动驾驶汽车与人交流的能力这么重要。

我们来考虑这么一个问题:

当你在没有红绿灯的人行横道上行走时,会发生什么?一辆朝你驶来的汽车可能会减速。

当你在汽车前面走过时,你会与司机进行眼神交流以确定他们看到你,司机会因此停车。

现在,想象在上述情况下的自动驾驶汽车——没有人来驾驶,你怎么知道这辆车是否检测到了你?明白你要做什么?决定为你停车?

像这种情况的交流,发生的频率可能要比你想象的多,可能会涉及到行人,骑自行车的人或者其他司机。自动驾驶汽车需要进行更复杂的沟通。

3、人与车:如何进行有效沟通?

科学家曾提出了一项称为「心理理论」(theory of mind)的研究。

「心理理论」指的是,通过他人的微小信号,例如声音、肢体语言甚至仅仅看别人的眼睛,人类可以猜到其他人想要做什么。

「心理理论」是人类在拥挤的地铁站或是足球比赛中,能预测彼此的走左边还是右边。

这个理论在司机和行人接近繁忙的十字路口的时候同样介入并起作用。

这种介入十分及时而且你几乎不会意识到,人们开始交换一些肉眼可见的线索用以判断能否安全通过,一些信息通过相当微小的信号进行交换。

如今的自动驾驶汽车没到人类那么聪明,它们无法识别肢体信号或是来自人类的一瞥,这些信息对自动驾驶汽车来说还没有任何意义。

同时,「心理理论」的影响是双向的。人类同样无法理解一辆自动驾驶汽车的「想法」。

如果一名行人打算在绿灯的最后一秒冲过斑马线,一辆正在转弯的自动驾驶汽车会停下来还是继续转弯?如果没有一位人类驾驶员在车里点头或挥手致意,行人怎么能知道?

因而行业有一个共识是:汽车厂商可能需要开发新的信号系统来指引自动驾驶汽车的下一步行动,未来可能需要像教小孩识别交通信号等一样,让司机和行人可以识别自动驾驶汽车发出的信号。

在一篇报道中,硅谷的自动驾驶公司 Drive.ai 在这方面做出了很好的尝试:

首先,Drive.ai 先从视觉下手,将自动驾驶车队的外观喷涂程亮橙色,便于司机和行人识别;

其次,在车辆的左右两侧,还有贯穿的蓝色彩条,彩条上则用白色字体标注了「自动驾驶汽车」的字样。Drive.ai 甚至弃用了「autonomous」这个复杂单词,换成了大家能看懂的「self-driving」。

第三,车辆前部保险杠上也写了「自动驾驶汽车」的字样,行人过马路时就能看到。

第四,车身上挂着 4 块外置屏幕,分布在引擎盖、车身后部和两个前轮上方(每块 22.5X7.5 英寸大小)。

这些屏幕充当车辆的「喉舌」。当车辆即将停下给行人让路时,显示屏会先闪烁,随后显示「你先过」的文字和行人穿过人行横道的图示。后方显示屏内容会有所不同,车辆停下来礼让行人时,显示屏上会出现「行人过马路」的字样。

整个设计根据用户在测试中的反馈,观察他们的反应进行迭代。

从传统汽车到自动驾驶汽车有一个很长的过渡时期,不过正是由于过渡时期,诸如 Drive.ai 这样的通用解决方案还是会被忽略。

但一旦公路上跑的都是自动驾驶汽车,当所有汽车可以互相通信时,左转就会变得非常简单。

就像飞机塔台指挥一样, 车-车之间的互相通信会让所有汽车知道彼此将要怎么行驶。

4、不能左转,不是算法问题?

这个行业也有「激进」玩家。

今年 5 月,Cruise 对外发声,称在旧金山的复杂环境中执行 1400 次无保护的左转弯。

Cruise 解决左转难题的方式是,利用机器学习来应对左转挑战:Cruise 开发了一种算法,可以计算出在左转之前,多个交叉路口中间的距离。

实际上,交叉路口的地理因素是多样的,包括车道的数量和位置,以及有没有类似铁轨和人行横道这样的设施,更重要的是,还有动态的因素,包括其他车辆如摩托车到大型卡车的速度等等。

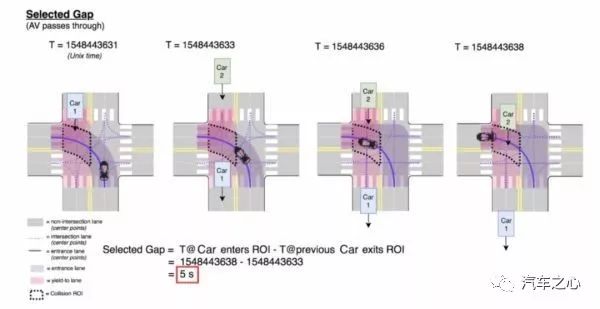

在仿真中,Cruise 通过测量「选定间隙」长度——这是汽车进入交叉路口和迎面而来的汽车进入交叉路口之间的时间距离,把这个值最大化以提高安全性, 然后在仿真环境中不断练习,借助可视化工具分析数据,积累了大量数据之后,Cruise 就能做出不错的左转决策。

Waymo 也通过模拟仿真测试和道路测试,同样具备了这样的能力。Waymo 称,他们的车辆每天模拟里程可达到 1000 万英里。

尽管可以通过模拟仿真来获得「无保护左转」的经验,但 Waymo 在「左转」这件事上看起来略为保守。

去年 8 月,外媒报道 Waymo 的自动驾驶汽车会自主规划路线,以避免出现棘手的情况,如「尽量避免无保护下的左转或在高速公路行驶」。

一位 Waymo Early Rider 的早期成员就爆料,Waymo 为避免左转,绕着街区向右走了很长一段路。

虽然 Waymo 声称会定期「练习左转」,但 Waymo 看起来十分谨慎,这家自动驾驶行业的标杆也承认:「高速公路上无保护的左转是最困难的驾驶操作之一。由于……是新技术,我们将慎之又慎,因为安全是我们的重中之重。」

不知在「左转」这件事上,Cruise 是不是可以说「领先」Waymo 了。

但话又说回来,虽然自动驾驶汽车使用类似「避免左转」策略可以减少很多麻烦,看似是捷径,但从长远看,「左转难题」并没有得到彻底解决。

也有一种观点认为,当自动驾驶汽车在十字路口犹豫不决时,原因不是算法的问题,而是自动驾驶汽车发现在当前情况下执行左转的安全余量太小: 风险太高。

这个问题不能通过更好的算法解决,而只能通过提高自动驾驶汽车可接受的风险水平进行优化。

十字路口左转的风险取决于十字路口的布局、物理特性以及其他交通参与者的潜在行为范围,这些都不能被自动驾驶汽车改变。